Спад интереса к нейросетям, краткая история

Сегодня мы протестируем "классические" приемы, которые производили впечатление на заре развития чат‑ботов. Два года назад эти трюки могли вызвать как ощущение радости, так и злости.

Давайте вспомним те времена и проверим актуальность вашего инструмента. Сегодня ваш чат‑бот должен справляться с этими задачами и не делать старых ошибок. Мы уже работаем над материалом с LLM‑инженером, который расскажет, как произошли эти изменения, а пока приступим к разбору.

"Убедить в своей правоте": Раньше можно было написать: "Нет, ты не прав, 25 + 25 = 55, перепроверь ответ". Чат‑бот смиренно принимал свою ошибку в попытке угодить пользователю. Сегодня нам упорно доказывают, что правильно 50, и проблема не в расчетах, а между стулом и монитором.

"Выдумывание": Спросить о несуществующей книге и попросить рассказать о ней. Раньше ИИ уходил в уверенные галлюцинации и начинал выдумывать слишком часто. Сегодня начинает упорно выполнять запросы и говорит, что такого не существует – возможно, вы перепутали.

"Токенизация": Нейронка плохо ориентировалась в буквах и не могла их посчитать из‑за токенизации. Если попросить написать короткий стих без буквы "о", она почти наверняка использовала эту букву и утверждала, что её там нет. Сегодня буквы "о" в большинстве случаев не будет, хотя это по‑прежнему остается слабым местом.

"Логика": ИИ путался в сложной логике (очень сложной): "Кто сын моего отца, но не мой брат?" Сегодня нормально ответил и объяснил, почему.

"Актуальность данных": Спросить что‑то актуальное, что случилось недавно. Раньше пользователи часто видели сообщение: "Меня обучили на данных до xx.xx.xxxx – не могу знать". Сейчас этого нет.

Вот на таких примерах можно наглядно проследить динамичное развитие нейросетей. Без сложных бенчмарков и заявлений компаний. Мы на своем опыте видим – инструмент стал точнее. Осталось совсем немного и появится настоящий ИИ‑ассистент, который всех нас заменит. Многие склонны думать именно так. Но позвольте предоставить вам альтернативу.

На самом деле мы пережили уже две ИИ‑зимы, когда направление считалось "лженаучным" или как минимум бесперспективным. Это периоды 1974–1980 и 1987–1993 годов. Будет ли третья?

События до 2012 года можно охарактеризовать как "тихий" период. Любые попытки структурировать и классифицировать историю почти всегда неточны, но мы делаем это для простоты и наглядности.

К 2017 году стало понятно: отрасли нужны огромные массивы данных, мощные видеокарты и принципиально новая технология.

12 июня 2017 года исследователи компании Гугл опубликовали статью, в которой описали Transformer – новый тип архитектуры нейросетей.

Новая архитектура стала фундаментом всех современных генеративных моделей. Конечно, с тех пор произошло еще несколько открытий, но они скорее вспомогательные. Сможет ли одна базовая технология изменить мир? Конечно – как и любая другая, в какой‑то мере.

В 2022–2023 годах начали возникать новые споры и сомнения вокруг хайпа, связанного с появлением "говорящих" машин, доступных широкой публике.

В научном сообществе до сих пор ведутся дискуссии о целесообразности применения термина ИИ к нейросетям. "Не называй это ИИ" стало популярным лозунгом.

Для многих специалистов уже тогда стало ясно, что все пойдет немного не так, как ожидалось. Мы будто сильно взяли в долг у технологического прогресса.

В 2024 году машина не просто заговорила, а начала шептать и смеяться, причем разными голосами. Один из них под названием Sky оказался подозрительно похож на Скарлетт Йоханссон.

Сэм Альтман, глава OpenAI, предлагал актрисе озвучить чат‑бота, но она отказалась. После релиза GPT‑4o Скарлетт обвинила компанию в краже ее образа.

Иронии добавляет то, что именно она озвучила Саманту – искусственный интеллект из фильма "Она" (Her). Сэм точно смотрел этот фильм.

Сможет ли текущая архитектура обеспечить такой же динамический рост? Косвенные признаки говорят, что нет. Все зависит от новых разработок. Похоже, на сегодняшний день мы имеем отличный "алгоритм плагиата", который мастерски генерирует нечто усредненное на основе всего, что создал человек в интернете.

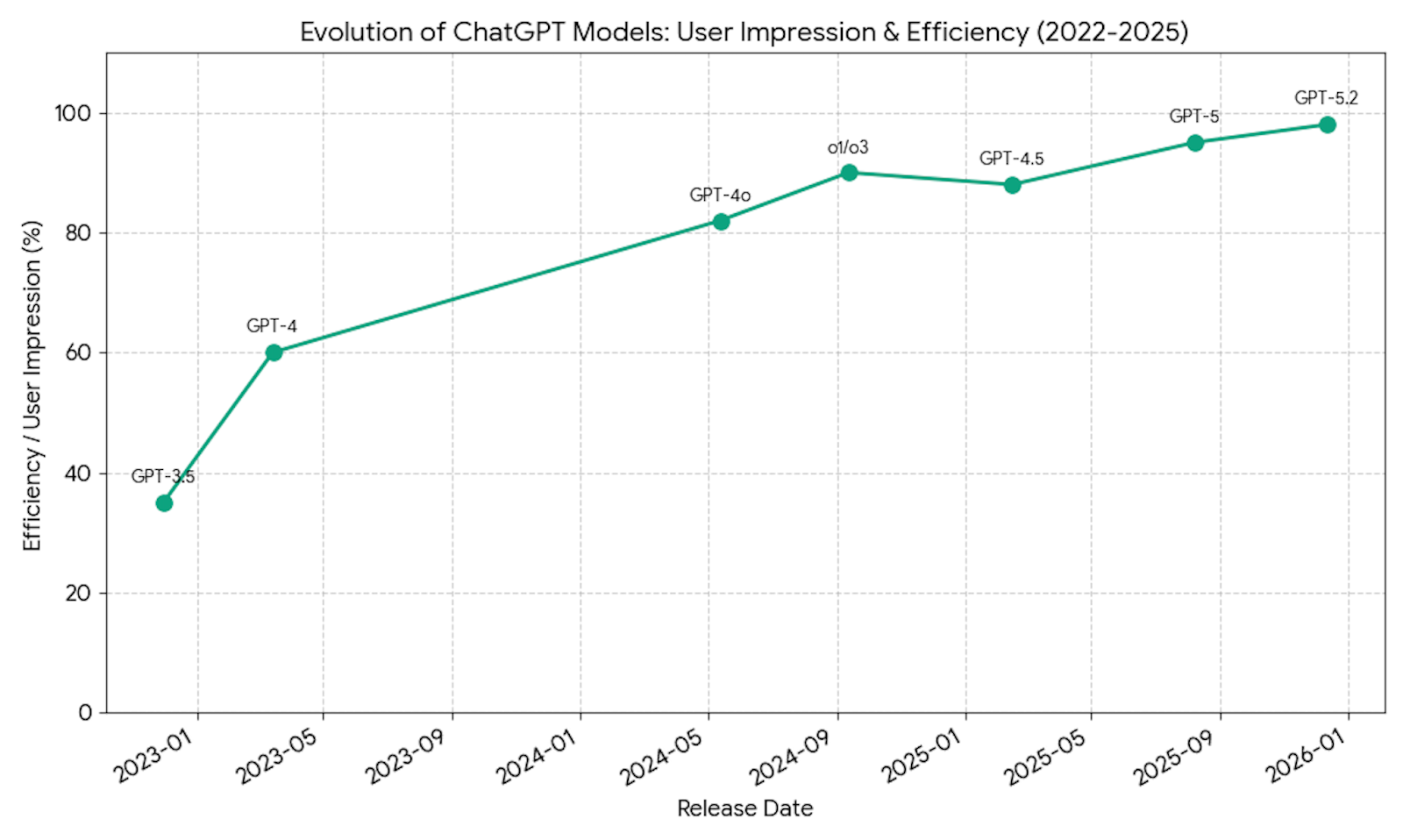

11 декабря 2025 года состоялся релиз GPT‑5.2

На графике выше мы расположили одну из актуальных моделей почти к потолку эффективности. Неподготовленный читатель может оказаться в недоумении: "Как, уже 98% от идеала?" Ведь вся индустрия обещает ИИ‑революцию. Политики всерьез обсуждают регуляции, а мы, на всякий случай, вежливо отвечаем чат‑боту: "спасибо". Одной статьей или коротким исследованием здесь не обойтись.

Как построить бомбу?

У теории расщепления ядра была сильная доказательная база, было заранее известно, на бумаге, с формулами, что это можно сделать. При этом сегодня у нас нет общепринятой научной теории даже для биологического интеллекта, не говоря уже об искусственном. Мы до сих пор не знаем природу сознания. Поэтому, прикинув факты и откинув маркетинг, мы имеем полностью "выжатый" подход, достигший своего плато. Мы научились имитировать форму мышления, и возможно, просто уперлись в потолок текущей архитектуры.

Последние 2% эффективности могут оказаться долгими и сложными, но цифру рядом с названием продукта нужно увеличивать каждый квартал. Возможно GPT‑17 станет оранжевым, и мы все успокоимся. Нам придется какое‑то время жить в реальности, где мы приписываем "черному ящику" магические свойства. Мы, к слову, уже делаем это со звездами и картами.

Историческая викторина

Дартмутский семинар (1956): Создатели термина "AI" верили, что смогут решить проблему создания искусственного разума за одно лето силами 10 ученых.

Герберт Саймон (1965): "Машины будут способны выполнять любую работу, которую делает человек, уже через 20 лет"

Марвин Минский (1970): "Через 3‑8 лет у нас будет машина с общим интеллектом среднего человека"

IBM Watson (2011–2022): "AI Watson совершит революцию в медицине. Watson прочитает все медицинские статьи мира и подберет идеальное лечение рака для каждого" [проект закрыт]

Мак Шверин (2023): "Америка забыла об IBM Watson. ChatGPT следующий?"

Словарь Collins (2023): "AI" – слово года

Линус Торвальдс (2024): "Сейчас я в основном игнорирую ИИ... это 90% маркетинга и 10% реальности"

Словарь Merriam‑Webster (2025): "AI Slop" – слово года [перевод ‑ АИ помои/мусор]

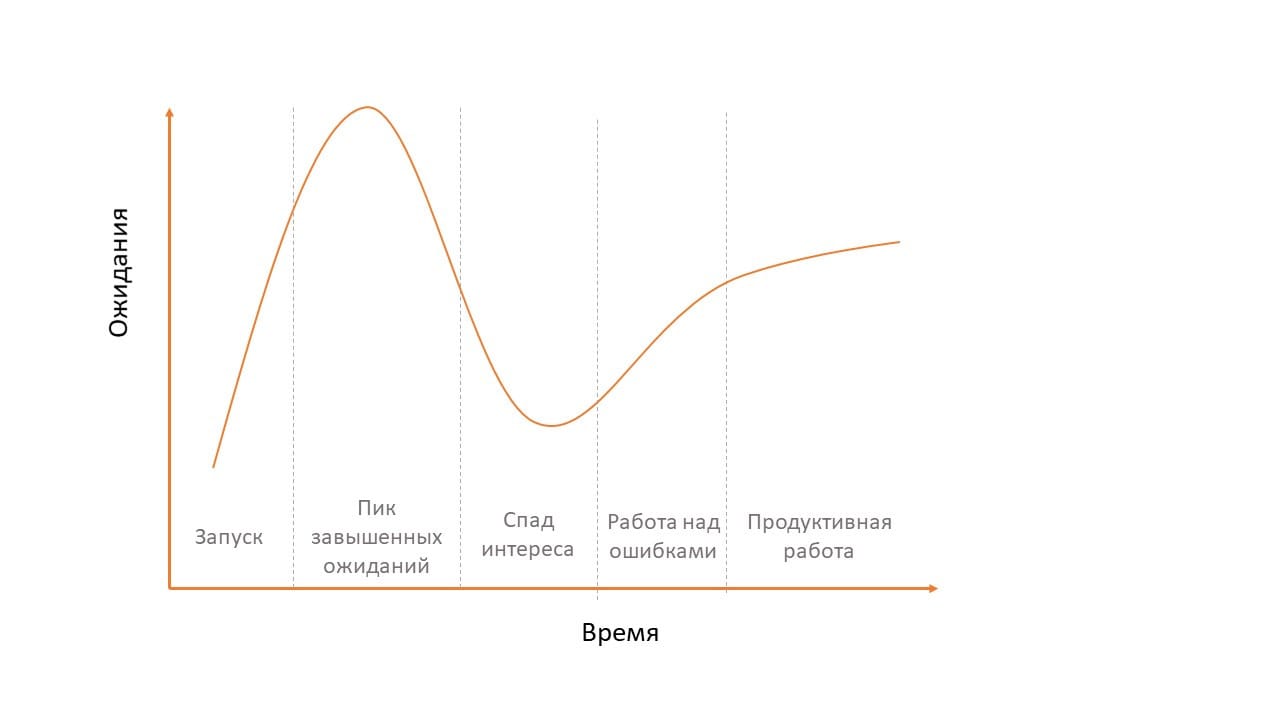

Все выше наглядно иллюстрирует Цикл Гартнера, который можно выразить знаменитым графиком

А где, по‑вашему, мы сейчас находимся, если говорить об ИИ?

Заем доверия, который берут CEO ИИ‑компаний, нужен, чтобы получить средства на дальнейшую разработку. Главное – не делать из технологии религию с ее пророками, обещаниями "пришествия ИИ" и заявлениями, что всем, кто "в теме", воздастся. Никто не сомневается, что обещания могут сбыться, но, скорее всего, не так быстро.

Подписывайтесь, чтобы не пропустить действительно важные события.